16 novembre 2020

Accueil I

par Thomas SAINT-AUBIN, Directeur des études Institut des Droits Fondamentaux Numériques, Président de Seraphin.legal et

Léa GOMEZ WINGELINCKX, Juriste numérique et déléguée à la protection des données adjointe de Seraphin.legal

– 16 novembre 2020

Dans le prolongement du DPO, le Digital Ethics Officer disposera d’une double compétence numérique et juridique.

Son rôle? Accompagner un déploiement éthique et respectueux des droits fondamentaux de l’IA. Côté régulation, la soft law est privilégiée à la hard law pour tenir compte de l’évolution rapide de ces technologies. Pour le DEO, il s’agira également d’évaluer et de garantir la ‘’compliance numérique’’ des grandes entreprises numériques européennes par rapport à ces nouveaux standards juridico-éthico-numériques.

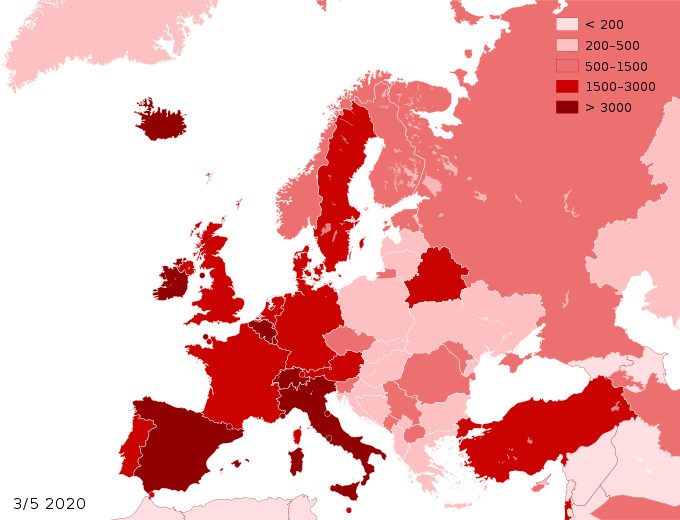

La pandémie de COVID-19 et les diverses périodes de confinement dans le monde ont relancé le débat sur la concilliation entre la préservation des droits et libertés fondamentaux et l’utilisation des technologies pour lutter contre la crise sanitaire. Plus que jamais, le sujet des libertés numériques est au coeur du débat public. Lors du débat parlementaire sur l’application Stop Covid, l’Institut des Droits Fondamentaux Numériques a plaidé pour la consécration d’une nouvelle déclinaison de la liberté fondamentale d’aller et venir : celle de se déplacer sans traçage numérique.

En effet, si les applications actuelles des technologies digitales (dont notamment l’intelligence artificielle et l’utilisation des données personnelles) viennent remettre en cause certains acquis dans nos libertés publiques, il nous appartient collectivement d’être résilient et de repenser leurs applications dans ce nouveau paradigme.

1.L’absence de séparation des pouvoirs dans la société numérique

Comme l’éminent professeur de droit Lawrence Lessig l’avait formulé dans un article en 2000, « Code is Law »; la régulation du numérique passe aujourd’hui davantage par l’architecture technique des plateformes que par les normes juridiques. De plus, la situation oligopolistique des GAFAM sur les marchés du numérique en font les véritables régulateurs.

Les GAFAM sont en effet à l’origine de normes privées, pouvant s’expliquer techniquement ou non, conditionnant l’accès à leur technologies, que ce soit pour des professionnels ou des particuliers. Nous connaissons bien aujourd’hui les conséquences de telles normes privées : diffusion massive de fausses informations, propagation de discours de haine, traçage numérique imposé, manipulation de l’opinion publique en pleine période d’élections démocratiques, absence de souveraineté numérique, pratiques anti-concurrentielles, etc.

Les individus ne sont ni représentés ni entendus et encore moins associés à l’élaboration de la gouvernance des données. Elle n’est nullement démocratique.

En pratique, le principe fondamental de séparation des pouvoirs n’existe pas dans notre société numérique.

2.Le constat d’une régulation par les machines et les algorithmes

Si l’état actuel du droit semble déjà en partie réglementer ces dérives, il est indéniable qu’il peine à se traduire techniquement dans le code de nos algorithmes et intelligences artificielles. Pourtant, l’urgence d’intervenir se fait sentir. Le récent boycott de Facebook et d’Instagram à travers le hashtag #stophateforprofit (« arrêtons la haine au service du profit ») confirme l’importance croissante pour les internautes de cette problématique. La rentabilité des grandes plateformes étant basée sur la publicité, l’objectif de ces dernières est que leurs utilisateurs y restent le plus longtemps possible et génèrent du clic. Que les informations soient vraies ou fausses, que le contenu soit bienveillant ou un acte de harcèlement, ce qui importe à ces plateformes est de « vendre du temps de cerveau disponible ».

La récente proposition de loi Avia sur les propos haineux a démontré toute l’obsolescence de la traditionnelle approche du régulateur fondée sur une expression dans le code juridique et qui fait abstraction de toute traduction dans le code numérique.

3.Une régulation numérique orientée ‘’soft law’’

La seule finalité du recours à la technologie numérique doit être la promotion des acquis des trois premières générations de droits de l’Homme.

Trop souvent, elles conduisent davantage à une perte de notre libre arbitre et sa substitution à une prédiction algorithmiques écrite nativement dans le code numérique par les grandes plateformes.

Les CGU des grandes entreprises du numérique , devenues de véritables Etats-plateformes, sont les nouvelles constitutions qui régulent nos libertés dans leur environnement numérique.

Avec son principe du Privacy by design, le Règlement Général à la Protection des données personnelles ( RGPD) constituait une innovation majeure pour introduire nativement la protection des données personnelles dans la société numérique.

Dans le prolongement de cette avancée , pouvons-nous introduire juridiquement et techniquement un concept de Human by Design dans l’innovation technologique?

Pour répondre à cet impératif, il existe deux grandes approches:

- Les grandes entreprises du numérique multiplient les initiatives collaboratives pour définir des chartes éthiques de régulation de l’IA et de gouvernance des données

- Les grandes institutions, comme l’Union Européenne, l’OCDE et le Conseil de l’Europe proposent régulièrement des textes de soft law

La démarche poursuivie pour nos institutions consistent principalement à réinterpréter dans ce ‘’droit mou’’ les droits et libertés fondamentaux existants.

De leurs côtés, dans leurs chartes éthiques, les géants numériques cherchent souvent à repenser nos droits de l’Homme dans une approche orientée ‘’CodeIsLaw’’.

À titre d’exemple, le 8 avril 2019, le groupe d’experts de haut niveau sur l’IA de la Commission Européenne a présenté des lignes directrices éthiques pour une intelligence artificielle digne de confiance. Ces lignes directrices proposent un ensemble de 7 exigences clés auxquelles les systèmes d’IA doivent répondre pour être considérés comme fiables. Il est d’ailleurs intéressant de remarquer que 3 des ces exigences se rapprochent fortement des grand principes posées par le RGPD : Transparence, Responsabilisation (Accountability) et Vie privée et gouvernance des données.

4.Vers des délégués à l’éthique du numérique pour garantir la conformité à la soft law

Au travers de ce droit mou, l’Union Européenne promeut ses valeurs et incite ses entreprises à garantir un véritable management des enjeux éthiques et juridiques de l’IA et des données.

Des IA dotées d’une conscience éthique, capable de respecter les droits et libertés fondamentaux des Humains: la commission européenne invite nos entreprises numériques à en faire un avantage concurrentiel

Le problème? Contrairement à la force contraignante du RGPD prolongée par les DPO et les CNIL européennes, la soft law destinée à réguler l’IA ne prévoit pas ab initio de mécanisme d’évaluation et de sanction. Pour y parvenir, nous devons largement former nos juristes à accompagner cette soft law dans des entreprises européennes qui feront de cette compliance numérique un avantage concurrentiel. Ce serait un levier considérable pour conquérir notre souveraineté numérique et comme le rappelle le professeur Jean-Louis Corréa, professeur à l’Université Virtuelle du Sénégal, pour initier un mouvement de décolonisation numérique les grands projets de transformations numériques de nos organisations.

A partir du 7 janvier 2021, une première promotion de 50 juristes sera formée pour être en capacité de manager les enjeux éthiques et juridiques des IA , qui se déploient massivement. 100% en ligne sur la plateforme lejuristededemain.com, , la formation #DigitalFundamentalRights est une initiative commune de l’EDHEC Augmented Law Institute, de l’Institute For Digital Fundamental Rights, du cabinet GOVERN&LAW et de la legaltech Seraphin.legal.

A l’image des DPO pour le RGPD, ces nouveaux experts , familiarisés à l’éthique du numérique et à l’innovation, et qui disposeront d’une connaissance à la fois technique (algorithme, intelligence artificielle, blockchain, internet des objects, etc.) et juridique, se chargeront d’accompagner la conformité de nos organisations vertueuses à cette soft law.

Ce véritable ‘’Digital Ethics Officer’’, sera notamment en capacité de reconnaître et d’anticiper les biais technologiques et de développer des offres éthiques et responsables. Entre l’innovateur, le déontologue et le juriste, le DEO (Digital Ethics Officer) sera la clef de voûte de ce nouveau management, à l’épicentre de l’analyse éthique, juridique et stratégique des projets digitaux de demain.

Il sera ainsi capable de faire entrer la norme juridique dans le code et de confirmer la transformation de l’adage « Code is Law » en « Law is Code ».

A l’issu de la formation, les 50 apprentis de cette première promotion devront présenter une épreuve pratique pour obtenir leur certification .

Des solutions Legaltech seront mis à leur disposition pour décliner concrètement les principes de soft law dans leurs organisations: legal bots pour générer un scoring de conformité entre les principes et la pratique, générateur de charte éthique thématique…

Les candidatures sont ouvertes en ligne sur la plateforme Lejuristededemain.com. Les lecteurs d’Archimag sont les bienvenus pour intégrer cette première promotion.

Auteurs:

Thomas SAINT-AUBIN, Directeur des études Institut des Droits Fondamentaux Numériques et Président de Seraphin.legal,

Léa GOMEZ WINGELINCKX, Juriste numérique et déléguée à la protection des données adjointe de Seraphin.legal.

![[DSA, AI Act] Régulation, et si l’Europe avait raison ? Podcast les Eclaireurs du Numérique avec Jean-Marie Cavada](https://idfrights.org/wp-content/uploads/2023/12/8c234391-01e8-40d4-9608-4ea6c80d4f11-440x264.jpg)